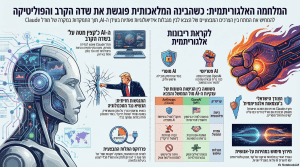

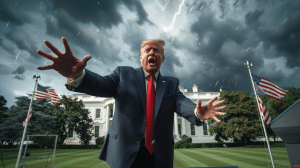

בשעה שהצבא האמריקאי נעזר במודל ה-AI "קלאוד" כדי לתכנן תקיפות באיראן, הנשיא טראמפ הכריז על החברה כ"שמאל רדיקלי" ואסר על השימוש בה. איך הפכה הבינה המלאכותית לסלע מחלוקת אידיאולוגי בין הפנטגון לבית הלבן, ואיך המלחמה האלגוריתמית משנה את פני המזרח התיכון?

המתח הביטחוני במזרח התיכון הגיע בסוף השבוע האחרון לשיא היסטורי עם פתיחת המבצע המשותף הנרחב של ארה"ב וישראל בשמי איראן. אך בעוד הטילים המדויקים והמטוסים החמקנים עשו את דרכם למטרות בעומק שטח האויב, התברר כי מאחורי הקלעים פועל "מוח דיגיטלי" שנוי במחלוקת שהפך ללב ליבה של סערה פוליטית בוושינגטון.

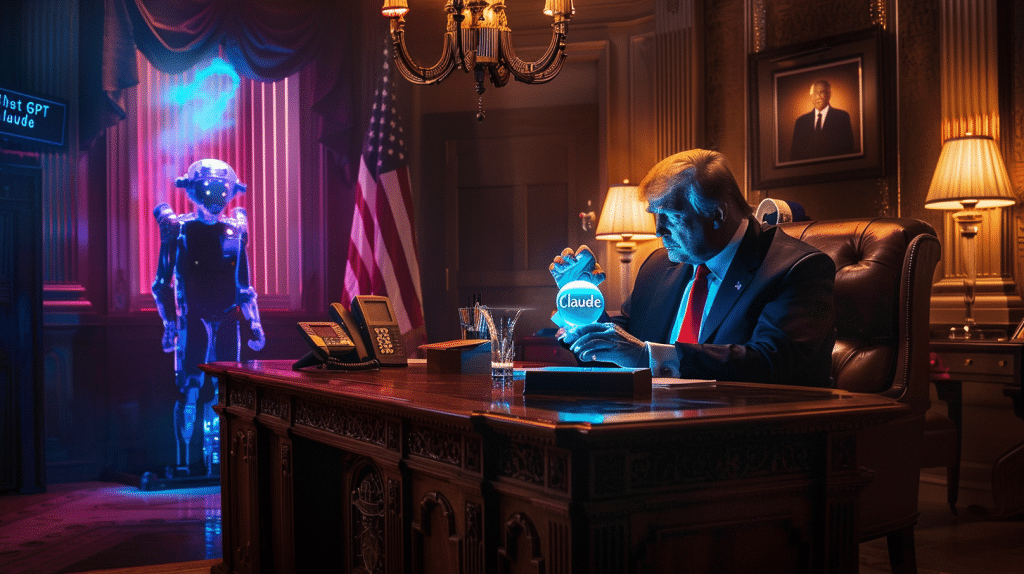

דיווחים ב-Wall Street Journal וב-Axios חושפים מציאות מדהימה: צבא ארה"ב השתמש ב-

Claude, מודל הבינה המלאכותית המתקדם של חברת אנתרופיק (Anthropic), כמרכיב קריטי בתכנון ובביצוע המבצע. המודל לא רק סייע בגיבוש מודיעין גולמי, אלא לקח חלק פעיל בבחירת מטרות, ניתוח נזקי תקיפה וביצוע סימולציות מורכבות של שדה הקרב בזמן אמת. כל זאת התרחש שעות ספורות בלבד לאחר שהנשיא דונלד טראמפ הכריז על נתק מוחלט מהחברה, מה שיוצר התנגשות חזיתית בין הצרכים המבצעיים של הגנרלים בשטח לבין האידיאולוגיה של הבית הלבן.

השורשים של הנתק: "בינה מלאכותית של השמאל הרדיקלי"

הסערה הפוליטית החלה ביום שישי האחרון, כאשר דונלד טראמפ, בשיאו של גל צווים נשיאותיים המעצבים מחדש את הממשל, פרסם הודעה חריפה במיוחד ברשת Truth Social. טראמפ תקף את אנתרופיק חזיתית וכינה אותה "חברת AI של השמאל הרדיקלי, המנוהלת על ידי אנשים שאין להם מושג איך העולם האמיתי נראה". הצו היה חד-משמעי: על כל סוכנויות הממשל הפדרלי, ובמרכזן משרד ההגנה, להפסיק את השימוש ב-Claude לאלתר.

השורשים של הזעם הנשיאותי נעוצים באירוע דרמטי מחודש ינואר האחרון: המבצע ללכידת נשיא ונצואלה, ניקולס מדורו. הצבא האמריקאי עשה אז שימוש נרחב ביכולות הניתוח של Claude כדי לאתר נכסים ולתכנן את הפשיטה. אנתרופיק, חברה שהוקמה על ידי יוצאי OpenAI על בסיס עקרונות נוקשים של "בטיחות AI" (AI Safety) וגישה הומניסטית, הגיבה בזעזוע. החברה הבהירה כי תנאי השימוש שלה (ToS) אוסרים במפורש על שימוש במודל למטרות אלימות, פיתוח נשק או מעקב פולשני. הניסיון של חברת טכנולוגיה פרטית להכתיב לצבא החזק בעולם "קווים אדומים" מוסריים נתפס בבית הלבן כלא פחות מחתרנות נגד האינטרס הלאומי.

המוח שמאחורי התקיפה: איך צבא משתמש ב-Claude?

כדי להבין את גודל המשבר, צריך להבין מה ה-AI עושה בפועל בחדרי המבצעים. בניגוד לשימוש האזרחי שבו אנו מבקשים מ-Claude לכתוב מייל, בפיקוד המרכז האמריקאי (CENTCOM) המודל משמש כ"קצין מטה על". הוא מסוגל לסרוק הררי נתונים שמגיעים מלוויינים, מזל"טים ומקורות אנושיים, ולהצביע על דפוסים שאדם עשוי לפספס.

במהלך התקיפה באיראן, המודל שימש להרצת תרחישי "מה אם": מה תהיה תגובת מערכות ההגנה האווירית האיראניות אם נתקוף מכיוון מזרח לעומת מערב? אילו מטרות תשתית יגרמו לנזק המקסימלי ליכולת הגרעינית במינימום פגיעה באוכלוסייה אזרחית? היכולת של Claude לעבד שפה טבעית מאפשרת למפקדים לשאול שאלות מורכבות ולקבל תשובות מנומקות תוך שניות, מה שמקצר משמעותית את "מעגל האש".

הפרדוקס המבצעי: התלות העמוקה שאי אפשר לנתק

למרות הצו הנשיאותי הנחרץ, המציאות בשטח הוכיחה שהטכנולוגיה של אנתרופיק כבר מושרשת עמוק מדי בתוך "מערכת העצבים" של הפנטגון. הוצאת כלי כזה בעיצומו של מבצע צבאי רגיש היא משימה בלתי אפשרית – מדובר בסיכון ישיר לחיי אדם ובפגיעה אנושה ביעילות התקיפה.

שר ההגנה,

פיט הגסת', ביטא את התסכול הזה בפוסט זועם ברשת X, בו האשים את אנתרופיק ב"יהירות ובגידה". הגסת' הצהיר כי "אמריקה לא תאפשר לענקיות הטכנולוגיה להכתיב לה איך לנצח במלחמות", אך באותה נשימה הודה במגבלות הכוח: הוא העניק לחברה "תקופת חסד" של שישה חודשים לטובת "מעבר חלק לשירות טוב ופטריוטי יותר". המשמעות היא שבחצי השנה הקרובה, ארה"ב תמשיך להשתמש ב-AI שהיא עצמה הגדירה כ"שמאל רדיקלי", פשוט כי אין לה ברירה אחרת.

OpenAI וסם אלטמן: הנשיקה של "ה-AI הפטריוטי"

בזמן שאנתרופיק נשרפת בגשרים מול הממשל, סם אלטמן, מנכ"ל OpenAI, מוכיח שוב שהוא אסטרטג פוליטי מבריק. אלטמן זיהה את הוואקום והזדרז למצב את החברה שלו כבת הברית הנאמנה של טראמפ. הוא הודיע על הסכמות לשילוב מודלי GPT ברשתות המסווגות ביותר של הצבא, מה שמסמן שינוי פילוסופי דרמטי.

בעוד אנתרופיק מתעקשת על "חוקה" למודל ה-AI שלה (Constitutional AI) שמונעת ממנו לסייע בלחימה, OpenAI נראית כמי שמוכנה להסיר את הכפפות. המיתוג החדש של OpenAI כחברה "פטריוטית" מבטיח לה תקציבי עתק מהפנטגון, אך מעורר דאגה בקרב מומחי אתיקה שחוששים מ-AI חסר מעצורים בשירות הכוח הצבאי.

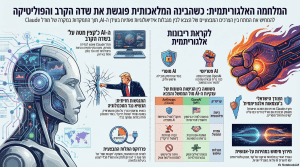

השלכות אסטרטגיות: המירוץ לחימוש אלגוריתמי

האירוע הזה מסמן את תחילתו של עידן חדש בביטחון הלאומי, המלווה בשאלות כבדות משקל:

- ריבונות טכנולוגית: המקרה מוכיח שמדינות אינן יכולות עוד להסתמך על חברות פרטיות ללא שליטה מוחלטת בטכנולוגיה. אנו צפויים לראות את ארה"ב, ואולי גם את ישראל, משקיעות מיליארדים בפיתוח מודלי AI ממשלתיים וריבוניים.

- ה-Alignment הצבאי: אם עד היום עסקנו בתיאום ה-AI לערכים אנושיים כלליים, עכשיו מתחיל המירוץ לתיאום ה-AI לערכים צבאיים. איך נראה AI שמאומן להיות "לוחם"? האם הוא יהיה אגרסיבי יותר?

- מלחמות פרוקסי של קוד: בעתיד, מלחמה בין מדינות תהיה גם מלחמה בין האלגוריתמים שלהן. ה-AI של ארה"ב ינסה להערים על ה-AI של איראן או סין, במאבק שמתרחש במהירות שמעבר להבנה אנושית.

הזווית הישראלית: הלקח עבור צה"ל

עבורנו בישראל, הדרמה הזו היא הרבה יותר מסיפור על פוליטיקה אמריקאית. צה"ל נחשב לאחד הצבאות המתקדמים בעולם בשימוש ב-AI (מ"מפעל המטרות" ועד ניתוח אותות מודיעיניים). עם זאת, התלות הישראלית בתשתיות ענן ובמודלים אמריקאיים היא כמעט מוחלטת.

המאבק בין טראמפ לאנתרופיק מבהיר שישראל חייבת לפתח "עצמאות אלגוריתמית". אם מודל AI אמריקאי שמוטמע במערכות ישראליות יחליט פתאום שמטרה מסוימת בלבנון או בעזה אינה עומדת בקריטריונים המוסריים שהוכתבו לו בעמק הסיליקון, זה עלול לשתק יכולות מבצעיות ברגע האמת. השאלה "מי מחזיק במפתחות של המודל" הופכת לשאלת ביטחון לאומי מן המעלה הראשונה.

סיכום: עתיד שדה הקרב כבר כאן

אנחנו נמצאים בנקודת אל-חזור. הבינה המלאכותית היא כבר לא כלי עזר, היא השחקן המרכזי בשדה הקרב המודרני. המאבק הנוכחי בוושינגטון הוא רק הפרומיל הראשון של המלחמה על השליטה בבינה המלאכותית הצבאית. בעולם שבו שניות קובעות את גורלם של עמים, מי שיחזיק ב-AI המהיר ביותר, החכם ביותר – ואולי גם הפחות "מוסרי" – הוא זה שינצח.

דיווחים ב-Wall Street Journal וב-Axios חושפים מציאות מדהימה: צבא ארה"ב השתמש ב-Claude, מודל הבינה המלאכותית המתקדם של חברת אנתרופיק (Anthropic), כמרכיב קריטי בתכנון ובביצוע המבצע. המודל לא רק סייע בגיבוש מודיעין גולמי, אלא לקח חלק פעיל בבחירת מטרות, ניתוח נזקי תקיפה וביצוע סימולציות מורכבות של שדה הקרב בזמן אמת. כל זאת התרחש שעות ספורות בלבד לאחר שהנשיא דונלד טראמפ הכריז על נתק מוחלט מהחברה, מה שיוצר התנגשות חזיתית בין הצרכים המבצעיים של הגנרלים בשטח לבין האידיאולוגיה של הבית הלבן.

דיווחים ב-Wall Street Journal וב-Axios חושפים מציאות מדהימה: צבא ארה"ב השתמש ב-Claude, מודל הבינה המלאכותית המתקדם של חברת אנתרופיק (Anthropic), כמרכיב קריטי בתכנון ובביצוע המבצע. המודל לא רק סייע בגיבוש מודיעין גולמי, אלא לקח חלק פעיל בבחירת מטרות, ניתוח נזקי תקיפה וביצוע סימולציות מורכבות של שדה הקרב בזמן אמת. כל זאת התרחש שעות ספורות בלבד לאחר שהנשיא דונלד טראמפ הכריז על נתק מוחלט מהחברה, מה שיוצר התנגשות חזיתית בין הצרכים המבצעיים של הגנרלים בשטח לבין האידיאולוגיה של הבית הלבן.