כשאנחנו מדברים ביומיום על בינה מלאכותית, המחשבה שלנו נודדת בדרך כלל לצ'אטבוטים שמסכמים לנו מיילים, עוזרים לנו בכתיבת קוד או מחוללים תמונות יצירתיים. אך בזמן שאנחנו משפרים את הפרודוקטיביות המשרדית שלנו, בקומה העליונה של הפנטגון ובחדרי המבצעים של צבא ארה"ב, ה-AI כבר מזמן אינה כלי עזר גנרי. היא הפכה למנוע המרכזי שמאחורי הלחימה המודרנית וללב הפועם של מה שמכונה "לוחמה אלגוריתמית" (Algorithmic Warfare) – עידן שבו המידע הוא הנשק הקטלני ביותר.

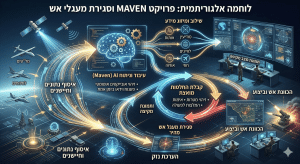

הכנו עבורכם סקירה מקיפה ומעמיקה על אחד הפרויקטים הסודיים והמשמעותיים ביותר של העשור האחרון: Project Maven. במהלך כנס AIPCon 9 של חברת פלנטיר (Palantir), חשפו בכירי הפנטגון לראשונה כיצד מערכות הבינה המלאכותית של החברה מאפשרות לסגור מעגלי אש במהירות שהייתה נחשבת בעבר למדע בדיוני. לא מדובר רק בשיפור טכני בתוכנה, אלא בשינוי פרדיגמה מוחלט באופן שבו מעצמות מנהלות לחימה, מקבלות החלטות גורליות בשטח ומזהות איומים מבעד ל"ערפל הקרב"."קליק ימני, קליק שמאלי": המלחמה בלחיצת כפתור

קמרון סטיילי, קצין הדיגיטל והבינה המלאכותית הראשי של הפנטגון (CDAO), הציג הדמיה חיה שהשאירה את הקהל פעור פה. הוא הראה כיצד המערכת של פלנטיר, המכונה MSS (Maven Smart System), מסוגלת לבצע "היתוך מידע" (Data Fusion) ברמה שטרם נראתה. המערכת שואבת נתונים בזמן אמת מהררי מקורות: צילומי לוויין ברזולוציה גבוהה, חיישני מודיעין אותות (SIGINT), מכ"מים קרקעיים ומערכות מעקב טיסות אזרחיות וצבאיות (ADS-B). "ברגע שזיהיתם משהו שאתם רוצים לתקוף, זה מה שאנחנו עושים," הסביר סטיילי בזמן שהדגים ממשק משתמש אינטואיטיבי להפליא, שנראה יותר כמו משחק מחשב מתקדם מאשר מערכת צבאית מסורבלת: "קליק שמאלי, קליק ימני, קליק שמאלי – וזהו." המערכת הראתה כיצד היא מצליחה לצמצם רשימה של אלפי מטרות פוטנציאליות בשטח עוין, לזקק את המידע מתוך ה"רעש" הדיגיטלי ולהתמקד ברכב ספציפי אחד בתוך חניון עמוס. היכולת הזו לבודד מטרה בודדת מתוך סביבה רועשת היא האתגר הגדול ביותר של המודיעין המודרני, ו-Maven פותרת אותו באמצעות אלגוריתמים של ראייה ממוחשבת (Computer Vision) הלומדים לזהות דפוסי תנועה וחתימות חום.

האצת ה-OODA Loop: משעות לשניות בודדות

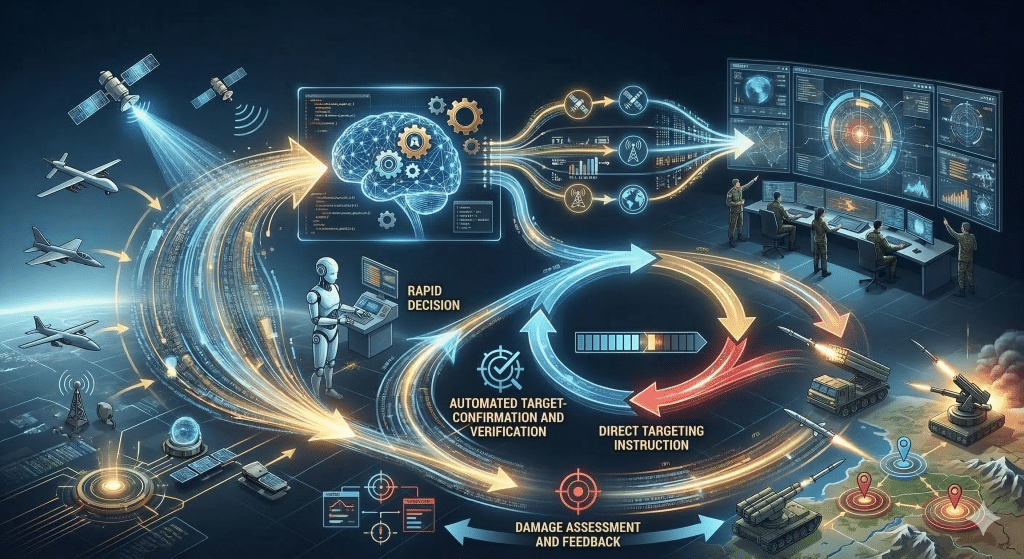

המהפכה האמיתית כאן היא לא רק הזיהוי, אלא מה שנקרא בעגה הצבאית "סגירת שרשרת הקטל" (Closing the Kill Chain). בתורת הלחימה, קיים מושג שנקרא לולאת ה-OODA (ראשי תיבות של Observe, Orient, Decide, Act). ככל שהצד הלוחם מבצע את הלולאה הזו מהר יותר מהיריב, הוא מצליח "להיכנס לתוך המוח של האויב" ולהשיג עליונות מבצעית מוחלטת. בעבר, התהליך של זיהוי מטרה, הצלבת מידע ממקורות שונים (לוויין מול מודיעין שטח), קבלת החלטה פיקודית, בחירת הנשק המתאים וביצוע התקיפה, דרש מעבר ידני ומייגע בין 8 או 9 מערכות מחשוב שונות שאינן מדברות זו עם זו. אנשי צוות אנושיים נאלצו להעביר נתונים ידנית, להשוות קואורדינטות על מפות פיזיות ולבזבז זמן יקר שהוביל לעיתים להחמצת המטרה או לנזק סביבתי. "כשמתחילנו, התהליך הזה לקח שעות," ציין סטיילי. "היום אנחנו עושים הכל בתוך מערכת אחת, ובזמן קצר משמעותית. אנחנו מדברים על מעבר משעות ארוכות של עבודת מטה לשניות בודדות של עיבוד אלגוריתמי. זה פשוט מהפכני."האלגוריתם שבוחר את הנשק: המלצות לפעולה בזמן אמת

אחת היכולות המתקדמות ביותר שהוצגו היא יצירת "קורס פעולה" (COA – Course of Action) אוטומטי. המערכת לא רק אומרת למפקד "הנה המטרה", אלא היא גם מבצעת אנליזה של הנכסים הצבאיים הזמינים באזור ומציעה לו איך לנטרל אותה בצורה האפקטיבית ביותר. בסימולציה שהוצגה, ה-AI ניתחה את המרחב והמליצה על המענה האופטימלי: מקלע בראונינג 0.5 המותקן על נגמ"ש "סטרייקר" (Stryker). המערכת שוקלת משתנים קריטיים כמו מרחק מהמטרה, מלאי תחמושת זמין, הסתברות לפגיעה (Probability of Hit) וסיכון לנזק נלווה (Collateral Damage). זהו שלב שבו הבינה המלאכותית הופכת משותף לניתוח נתונים לשותף אסטרטגי לקבלת החלטות טקטיות. המפקד האנושי נשאר "בלולאה" (Human-in-the-loop), אך הוא מקבל החלטה על בסיס נתונים מעובדים ומדויקים, מה שמפחית דרמטית את העומס הקוגניטיבי תחת אש.אלכס קארפ ופלנטיר: הלוחמים של עמק הסיליקון

מנכ"ל פלנטיר, אלכס קארפ, הפך בשנים האחרונות לאחת הדמויות המשפיעות והשנויות במחלוקת בעולם הטכנולוגי. בזמן שחברות ענק כמו גוגל ומיקרוסופט מתמודדות עם מחאות עובדים פנימיות סביב שיתוף פעולה עם מערכת הביטחון (מה שהוביל כזכור ליציאתה של גוגל מפרויקט Maven המקורי), קארפ אימץ בגאווה את התפקיד של "ספק ה-AI של העולם החופשי". קארפ טוען כי הטכנולוגיה של פלנטיר היא זו המאפשרת לארה"ב ולבעלות בריתה לשמור על הרתעה בעידן שבו האויבים הופכים למתוחכמים יותר מבחינה דיגיטלית."העובדה שניתן כעת לתקוף בצורה מדויקת יותר, מהירה יותר, ולרתום את כל המשאבים של הצי והצבא כנגד האויב – שינתה לחלוטין את הדרך שבה מלחמות מתנהלות," אמר קארפ בראיון ל-CNBC. "קראתי בעיתונות ש-Project Maven הוא עמוד השדרה המרכזי של היכולת הזו, ואני יכול לומר שנתנו לאמריקה יתרון משמעותי בשדה הקרב."קארפ ידוע בגישתו הישירה והבוטה לעיתים כלפי ממשלות. הוא הבהיר כי פלנטיר אינה חברת תוכנה רגילה שמחפשת "לידים" במחלקות המכירות. "אני אומר לממשלות בכל העולם: אנחנו לא באים לעשות פגישות מכירה ל-Maven. אתם יודעים שזה עובד, אנחנו יודעים שזה עובד. בואו למשרד שלי ותסבירו איך אתם הופכים את החיים שלנו לקלים יותר, כי אין לנו את הפנאי להתעסק עם בירוקרטיה ממשלתית איטית."

הדרמה הפוליטית: Anthropic, Claude ושר הביטחון

למרות ההצלחה הטכנולוגית המרשימה, Project Maven נמצא בלב סערה פוליטית ומשפטית חסרת תקדים בארה"ב. דיווחים ב"וושינגטון פוסט" מצביעים על כך שמודל השפה Claude של חברת Anthropic הוטמע בתוך המערכת כדי לסייע בניתוח טקסטואלי, סיכום דוחות מודיעין והפקת תובנות מתוך הררי מלל שנאספים מהשטח. עם זאת, שיתוף הפעולה הזה עלה על שרטון. שר ההגנה פיט הגסת' פעל להכנסת Anthropic ל"רשימה שחורה" צבאית לאחר שהחברה סירבה לכאורה להעניק לפנטגון גישה בלתי מוגבלת למודלים שלה (Unfettered Access). המתיחות החריפה עוד יותר כאשר הנשיא דונלד טראמפ הורה לכל הסוכנויות הפדרליות להפסיק להשתמש במוצרי Anthropic תוך שישה חודשים. בתגובה, Anthropic הגישה תביעה נגד הפנטגון והבית הלבן בניסיון לחסום את הצו. המאבק הזה מדגיש את המתח המובנה והמסוכן שבין חברות AI אזרחיות, השמות דגש על "בטיחות AI" (AI Safety), לבין הצרכים הביטחוניים הלאומיים הדורשים גישה עמוקה ויכולות "התקפיות".המדריך הצבאי לאוריינות נתונים: הלוחם כשותף לאלגוריתם

כדי שהמערכות הללו לא יהיו "קופסה שחורה" בלתי מובנת, צבא ארה"ב החל להפיץ מדריכים לאוריינות נתונים (Commander and Staff Guide to Data Literacy) בקרב הקצונה הבכירה והדרגים המבצעיים. המדריך מציין כי Maven הוא חלק מ"יכולות הקצה" שעליהן חיילים נשענים כיום כדי לקבל החלטות גורליות. המטרה של הפנטגון היא שחיילים לא יהפכו ל"לחוצי כפתור" עיוורים, אלא יפתחו הבנה ביקורתית של המערכת. הם נדרשים להבין את המגבלות של ה-AI, את הסיכוי להטיות באלגוריתם (Biases) ואת החשיבות של פיקוח אנושי מתמיד. היכולת להבחין בין המלצה נכונה של המכונה לבין טעות טכנית היא המיומנות החדשה שנדרשת מהלוחם המודרני.השלכות אסטרטגיות: המזרח התיכון כמעבדה טכנולוגית

על פי דיווחים שונים, ה-Maven Smart System כבר לקחה חלק פעיל ומכריע בפעילות ארה"ב בזירות מורכבות, כולל בעימותים מול גורמים הקשורים לאיראן ובמהלך מבצעים במפרץ הפרסי. המערכת הוכיחה את עצמה ביכולת לזהות משגרי טילים ניידים ויחידות קומנדו המנסות להיטמע באוכלוסייה אזרחית – משימה שהייתה כמעט בלתי אפשרית לביצוע אנושי בזמן אמת.בשורה התחתונה: האם אנחנו בדרך למלחמה אוטונומית?

Project Maven, שהחל כפיילוט שנוי במחלוקת של גוגל ב-2017, הפך תחת פלנטיר למפלצת טכנולוגית שמשנה את פני המלחמה. אנחנו כבר לא מדברים על בינה מלאכותית ככלי לשיפור פרודוקטיביות או חוויות משתמש, אלא ככלי לשליטה במרחב הקיומי. היכולת להפוך נתונים לפעולות קטלניות בתוך שניות בודדות מעניקה עוצמה אדירה למחזיקים בה, אך היא גם מציפה שאלות אתיות כבדות משקל:- אחריות: מי נושא באחריות משפטית ומוסרית כשהאלגוריתם טועה ומזהה רכב אזרחי כמטרה צבאית?

- אוטונומיה: כמה רחוק אנחנו מהרגע שבו ה-AI לא רק תמליץ על נשק, אלא גם תפעיל אותו באופן עצמאי?

- פרטיות: מה המשמעות של מערכת מעקב גלובלית המסוגלת לזהות כל אדם ורכב על פני הגלובוס בזמן אמת?