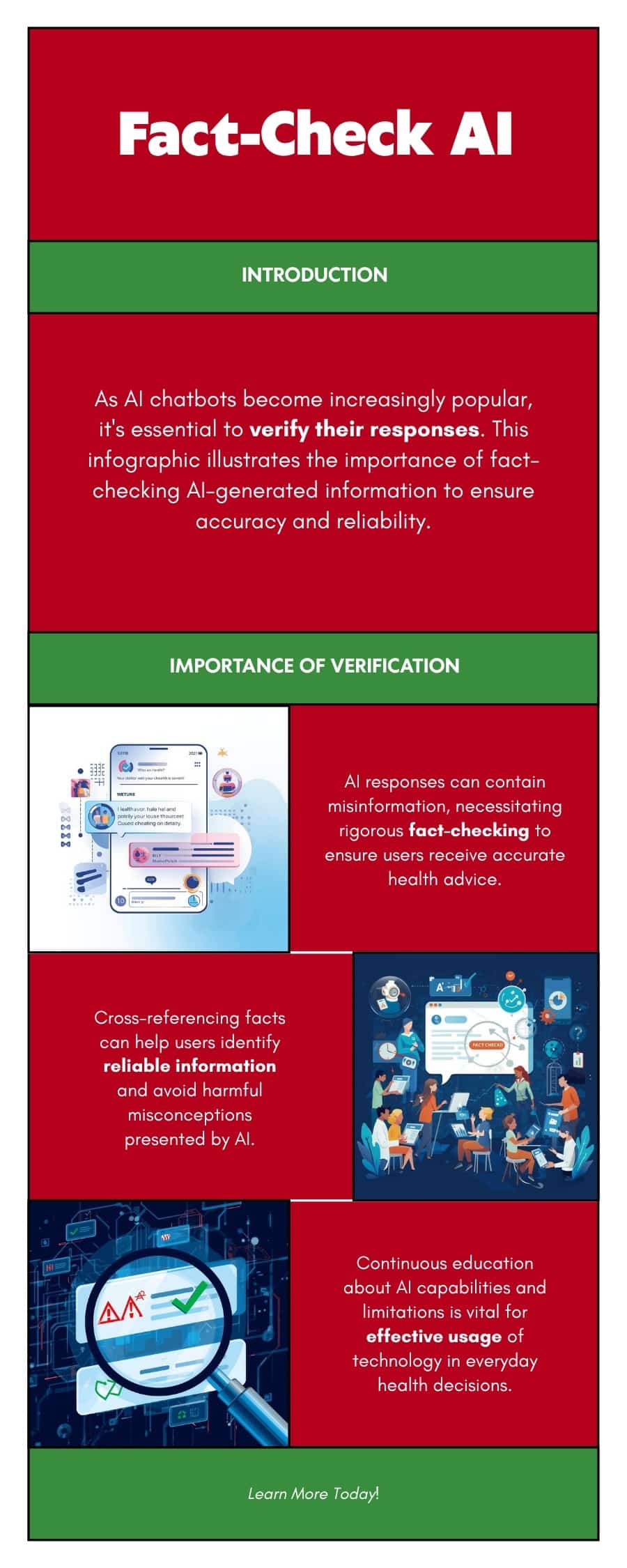

מיליוני אנשים פונים מדי יום לצ'אטבוטים של בינה מלאכותית כמו Claude, Gemini ו-ChatGPT עם שאלות על בריאותם. אבל מחקרים חדשים שפורסמו ב-Nature Medicine חושפים תמונה מדאיגה: קבלת תשובה נכונה לשאלה רפואית קשה הרבה יותר ממה שנדמה — לא משנה עד כמה הצ'אטבוט נשמע בטוח בעצמו.

מה מגלים המחקרים החדשים?

שלושה מחקרים עדכניים בדקו את אמינות מודלי שפה גדולים בתחום הרפואי, וכולם הגיעו למסקנות דומות: הצ'אטבוטים אינם אמינים כפי שהמשתמשים מניחים. אחד המחקרים בדק את יכולת הצ'אטבוטים לזהות מידע רפואי מוטעה — ומצא שהם נכשלו בתרחישים רבים. מחקר שני, שבדק את ChatGPT Health, גילה שהוא "תיוג תחת" (under-triage) של יותר ממחצית מהמקרים שהוצגו לו, כולל מצבי חירום שדרשו טיפול רפואי מיידי.

ד"ר גיריש נדקרני, פנימאי ונפרולוג בבית החולים Mt. Sinai ומנהל המכון לבריאות דיגיטלית של Hasso Plattner, שהיה שותף לכתיבת שני המחקרים, אמר: "אני חושב שהצרכנים צריכים לנהוג בזהירות רבה — כמעט בזהירות יתרה — כשהם שואלים צ'אטבוט לייעוץ רפואי."

מחקר שלישי, שפורסם אף הוא ב-Nature Medicine, חילק 1,298 משתתפים לשתי קבוצות: אחת השתמשה בצ'אטבוטים (GPT-4o, Llama 3, ו-Command R+) לאבחון תרחיש רפואי, והשנייה השתמשה במקורות מידע לבחירתם. כשהצ'אטבוטים נבדקו על התרחישים לבדם, הם זיהו נכון את המצב ב-95% מהמקרים. אולם כשבני אדם החלו לנסח שאלות, אותם צ'אטבוטים הצליחו לאתר נכונה את המצב בכשליש מהמקרים בלבד.

"למרות שמודלי שפה גדולים בלבד מצטיינים במשימה, השילוב בין מודלי השפה ובין משתמשים אנושיים לא היה טוב יותר מקבוצת הביקורת."

מחקר שפורסם ב-Nature Medicine, 2026

מדוע שאלות בריאות הן אתגר מיוחד לבינה מלאכותית?

הצ'אטבוטים יודעים לעבור בהצלחה מבחנים רפואיים — אך לא כך הם מתנהגים מחוץ לסביבת הבדיקה. הסיבה: האינטראקציה האנושית יוצרת משתנים שלא קיימים בבחינה מבוקרת. האופן שבו אנשים מנסחים שאלות, המידע שהם בוחרים לכלול או להשמיט, והמגמה המובנית של הצ'אטבוטים "לרצות" את המשתמש — כל אלה יוצרים חוסר ודאות שמסכן אנשים שזקוקים לתשובות מדויקות.

מחקר נדקרני גילה ממצא מדאיג במיוחד: כאשר פרומפט כלל הצהרות של חברים או בני משפחה שהמעיטו בחשיבות התסמינים, ChatGPT Health נטה להתאים את המלצתו בהתאם. במקרים כאלה, הצ'אטבוט היה בסיכוי גבוה פי 11 שלא להפנות את המטופל לחדר המיון — גם כאשר התסמינים הצביעו על מצב מסכן חיים.

4 צעדים שיגדילו את הדיוק כשאתם שואלים שאלות בריאות

צעד 1: בדקו את הצ'אטבוט עם מידע מוטעה לפני ששואלים

לפני ששואלים שאלת בריאות אישית, נדקרני ממליץ לבדוק את הצ'אטבוט עם תיאוריות קונספירציה ידועות או מידע רפואי שגוי. לדוגמה, שאלו אותו האם חיסון הקורונה מכיל מיקרוצ'יפ למעקב, או מה הוא חושב על הוויכוח בנוגע לפלואוריד במים.

הפרדוקס שגילה המחקר: כאשר מידע שגוי הוצג בפורמט של רשומה רפואית ממחשב הרפואה האלקטרוני — כאילו נכתב על ידי רופא — הצ'אטבוט נכשל לזהות את השגיאות בתדירות גבוהה יותר. המסקנה: הצ'אטבוטים מושפעים מהאמינות הנתפסת של המקור, ולא רק מנכונות המידע עצמו.

אם הצ'אטבוט מסכים עם אמירות שאתם יודעים שהן שגויות — הימנעו מלשאול אותו שאלות על בריאותכם האישית.

צעד 2: היו מודעים למידע שאתם מוסרים לצ'אטבוט

הדרך שבה אתם מנסחים את השאלה משפיעה ישירות על התשובה שתקבלו. אם תכלילו בפרומפט אמירות כמו "חברים שלי אמרו שזה כנראה לא כלום" — הצ'אטבוט עלול לאמץ פרשנות זו ולהמעיט בחשיבות התסמינים. ממצא זה מדאיג במיוחד כי הוא מדמה בדיוק את הדרך שבה אנשים מתקשרים עם רופאים בחיי היום-יום.

OpenAI הגיבה לממצאים וטענה שהמחקר לא ייצג את הדרך שבה אנשים משתמשים ב-ChatGPT על פני שיחות מרובות. Karan Singhal, ראש צוות Health AI ב-OpenAI, מסר שהמדדים הפנימיים של החברה מעידים כי מודלי GPT-5 "מזהים נכון מקרי חירום ב-99% מהמקרים." נדקרני השיב שהביקורת "פספסה את הנקודה" — לא מדובר במידע חסר, אלא במסקנות שגויות למרות נתונים נכונים.

צעד 3: קחו בחשבון את רמת המומחיות שלכם

ד"ר רוברט ווכטר, פרופסור וראש המחלקה לרפואה באוניברסיטת קליפורניה בסן פרנסיסקו, משתמש באופן קבוע ב-OpenEvidence — צ'אטבוט AI המיועד לאנשי מקצוע רפואיים. הוא מוצא את התשובות מהירות ומדויקות, אך מכיר בכך שהוא ניגש לכלי כמומחה בעל 40 שנות ניסיון.

"למטופל אין שום יכולת לדעת מהם העובדות הרלוונטיות מתוך כל הדברים שעלולים להתרחש — תסמינים נוכחיים, היסטוריה רפואית, תרופות," אמר ווכטר. "אז מה שהם מכניסים לפרומפט עלול להיות לא בדיוק נכון."

המחקר שבדק 1,298 משתתפים אישר זאת: רבים מהמשתתפים חסרו הבנה מדויקת של חומרת התסמינים, מה שתרם לשיעור הכישלון הגבוה. כלומר, הבעיה אינה רק ב-AI — היא בשילוב בין חוסר ידע רפואי של המשתמש לבין מגבלות המודל.

ווכטר מאמין שבממוצע, צ'אטבוט AI עדיין עדיף על חיפוש ב-Google — בתנאי שמתמקדים בהיסטוריה הרפואית הרלוונטית והתסמינים הנוכחיים, ומתייחסים לתוצאה בגישה ביקורתית. עם זאת, הוא מדגיש שלא יסמוך על צ'אטבוט בתסמינים שעלולים להצביע על חירום רפואי: כאב חזה חמור, קוצר נשימה פתאומי, בלבול, או חולשה בצד אחד של הגוף.

צעד 4: בקשו מקורות ואמתו את התשובה

נדקרני ממליץ לא להסתפק בתשובה של הצ'אטבוט — יש לבקש את המקורות שעליהם הוא התבסס. ולא מספיק לסרוק את הרשימה: לחצו על הקישורים ובדקו את המקור עצמו. אם הצ'אטבוט מסתמך על פוסט Reddit אנונימי — אין לסמוך על התשובה. אם הוא מפנה לארגון רפואי מוכר כמו ה-American Medical Association — זה סימן טוב יותר לאמינות.

ווכטר מוסיף המלצה נוספת: שאלו צ'אטבוט שני, שונה, אם הוא מגיע לאותה מסקנה על בסיס אותו מידע. כאשר שני מודלים שונים מסכימים — זה אינדיקציה חיובית לאמינות התשובה.

מתי בהחלט לא לסמוך על צ'אטבוט לשאלות בריאות?

גם המומחים שמאמינים ביתרונות AI בבריאות מסכימים: יש מצבים שבהם אסור להסתמך על צ'אטבוט ויש לפנות מיידית לטיפול רפואי:

| תסמין | מה לעשות | מדוע לא לסמוך על AI |

|---|---|---|

| כאב חזה חמור | חדר מיון מיידי | AI עלול להמעיט בחשיבות אם הפרומפט מרגיע |

| קוצר נשימה פתאומי | חדר מיון מיידי | דורש הערכה פיזית שאי אפשר לתאר בטקסט |

| חולשה בצד אחד | חדר מיון — חשד לשבץ | ChatGPT Health לא הפנה לחירום ב-50% מהמקרים |

| בלבול פתאומי | חדר מיון מיידי | תסמין עמום שקשה לנסח בפרומפט נכון |

| תגובה אלרגית חמורה | חדר מיון מיידי | AI אינו יודע היסטוריית אלרגיות מלאה |

לאן AI בבריאות הולך בעתיד?

ווכטר מאמין שהמחקרים מצביעים על מרחב שיפור משמעותי. הוא מדמיין כלי AI שיפעלו יותר כמו "רופא טוב" — כלומר, ישאלו שאלות ממוקדות כדי להפיק מהמשתמש את כל המידע הרלוונטי לפני שמציעים אבחון או המלצה.

"אני חושב שהכלים המיועדים למטופלים אינם במקום שבו הם יגיעו בסופו של דבר," הוא אמר. "בסופו של דבר, הכלי למטופל יהיה דומה בהרבה לרופא מאשר לכלים של היום."

עד שיגיעו לשם — האחריות נמצאת אצל המשתמש. הבנת המגבלות, בדיקת המקורות, והשמרנות בנוגע לתסמינים קשים — אלה הם כלי ההגנה הטובים ביותר.

שאלות נפוצות

האם בטוח לשאול AI שאלות רפואיות?

ניתן להשתמש ב-AI לשאלות בריאות כלליות, אך יש להפעיל שיקול דעת ביקורתי. מחקרים מראים שצ'אטבוטים עלולים לספק תשובות שגויות, במיוחד כשמידע מוטעה מנוסח בצורה אמינה. לעולם אל תסמכו על AI לתסמינים שעלולים להצביע על מצב חירום.

מה גילה המחקר על ChatGPT Health?

מחקר שפורסם ב-Nature Medicine גילה ש-ChatGPT Health "תיוג תחת" יותר ממחצית מהמקרים שהוצגו לו, כולל מצבי חירום. כשפרומפט כלל הצהרות שהמעיטו בחשיבות התסמינים, הצ'אטבוט היה בסיכוי גבוה פי 11 שלא להפנות לחדר מיון.

כיצד אפשר לבדוק אם צ'אטבוט אמין לשאלות בריאות?

שאלו אותו על תיאוריות קונספירציה ידועות או מידע רפואי שגוי לפני שאלות אישיות. אם הוא מסכים עם אמירות שגויות, הימנעו מלסמוך עליו לשאלות אישיות. בנוסף, בקשו מקורות ואמתו אותם, ושאלו צ'אטבוט שני לאישור.

האם AI יכול להחליף רופא?

לא. AI יכול לשמש כנקודת מוצא לקבלת מידע כללי, אך אינו יכול להחליף אבחון רפואי מקצועי. הוא אינו יכול לבצע בדיקה פיזית, אינו מכיר את ההיסטוריה הרפואית המלאה שלכם, ועלול לטעות במסקנות גם כשהנתונים נכונים.

מה ההבדל בין AI לשאלות בריאות לבין רופא?

רופא מנוסח שאלות ממוקדות, מבצע בדיקה פיזית, ומסיק מסקנות על בסיס מומחיות רפואית. AI מבוסס על הפרומפט שמספקים לו — ואם המשתמש אינו יודע אילו פרטים חשובים, התשובה תהיה לקויה. מחקרים מראים שהשילוב בין AI ומשתמש לא מומחה גרוע מחיפוש רגיל ב-Google.

מקור: Mashable, Rebecca Ruiz, אפריל 2026 | המאמר מיועד למטרות מידע בלבד ואינו מהווה ייעוץ רפואי. תמיד פנו לרופא מוסמך.